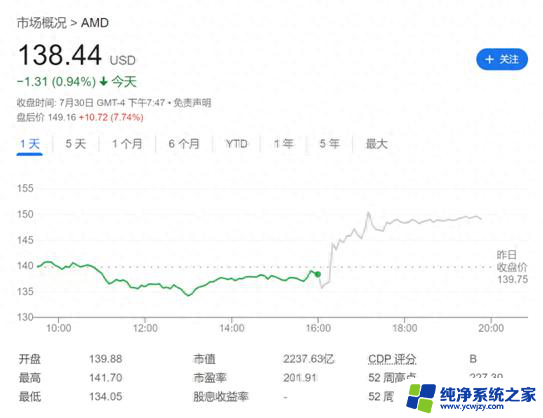

1530亿颗晶体管!AMD甩出最强AI芯片,单个GPU轻松跑大模型

作者 | ZeR0

编辑 | 漠影

芯东西6月14日报道,今日凌晨,英伟达的头号劲敌AMD,终于放出了令人期待已久的AI大招。

2014年,苏姿丰成为AMD CEO时,这家芯片企业正濒临生存危机,裁员约1/4,股价徘徊在2美元。随后在苏姿丰的掌舵之下,AMD完成了漂亮的转身,9年来股价飙升近30倍,对英伟达和英特尔两家顶级芯片巨头形成了制衡。

随着生成式AI飓风席卷全球,英伟达GPU被各家大厂争相抢购,焦点很快转移到AMD身上——AMD能否生产出足够强大的AI芯片来打破英伟达近乎垄断的市场地位,抓住新一波AI浪潮?

今日,AMD交出阶段性答卷。

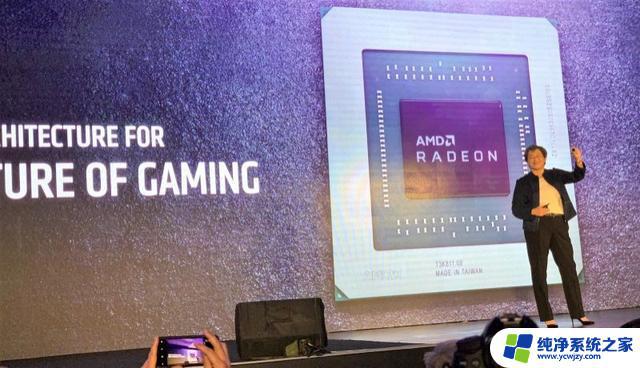

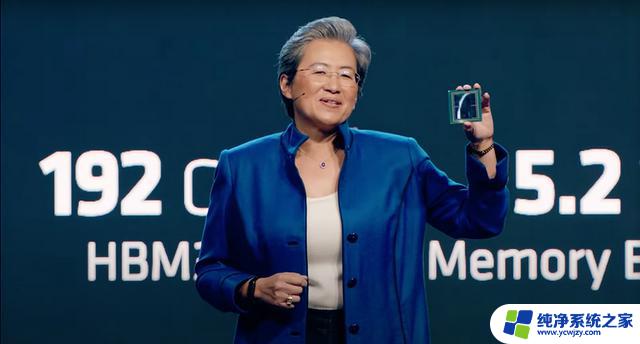

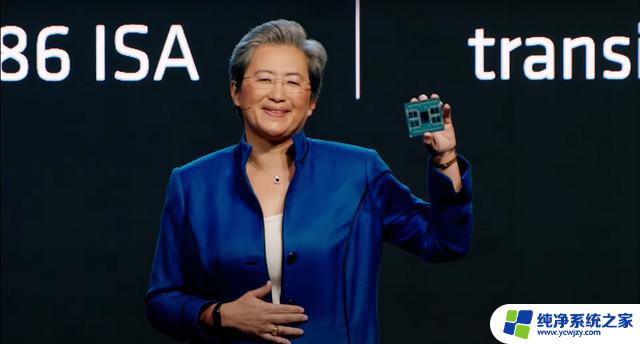

在展示下一代AI芯片MI300X加速器时,苏姿丰满面笑容地说:“我爱这颗芯片”。

MI300X是一个纯GPU版本,采用AMD CDNA 3技术,使用多达192 GB的HBM3高带宽内存来加速大型语言模型和生成式AI计算。

AMD主要客户将在第三季度开始试用MI300X,第四季度开始全面生产。另一种型号Instinct MI300A现在正在向客户发售。

苏姿丰说,人工智能是AMD“最大、最具战略意义的长期增长机会”。

现场,AMD与明星AI独角兽企业Hugging Face宣布了一项新的合作伙伴关系,为AMD的CPU、GPU和其他AI硬件优化他们的模型。

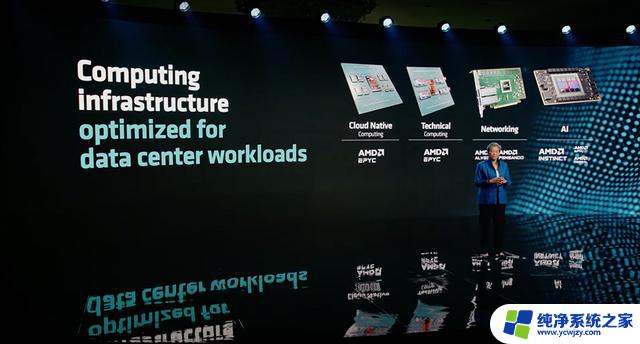

除了AI芯片外,AMD还推出专为云计算和超大规模用户设计的全新EPYC服务器处理器,代号为Bergamo,每个插槽最多包含128个内核,并针对各种容器化工作负载进行了优化。

亚马逊旗下云计算部门AWS、甲骨文云、Meta、微软Azure的高管均来到现场,分享在其数据中心使用AMD芯片及软件的感受。

01.

加速生成式AI:

192GB HBM3,单个GPU跑大模型

此前,AMD Instinct GPU已经被许多世界上最快的超级计算机采用。

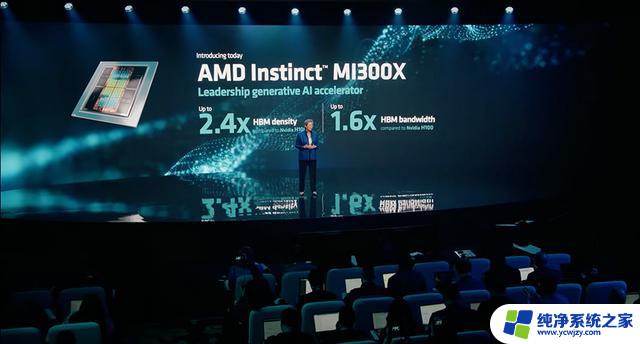

MI300X加速器是AMD Instinct MI300系列的新成员,提供一个仅有GPU配置的芯片版本。

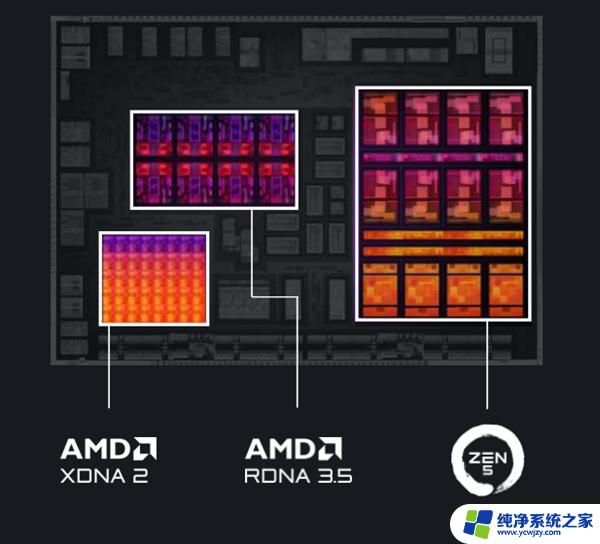

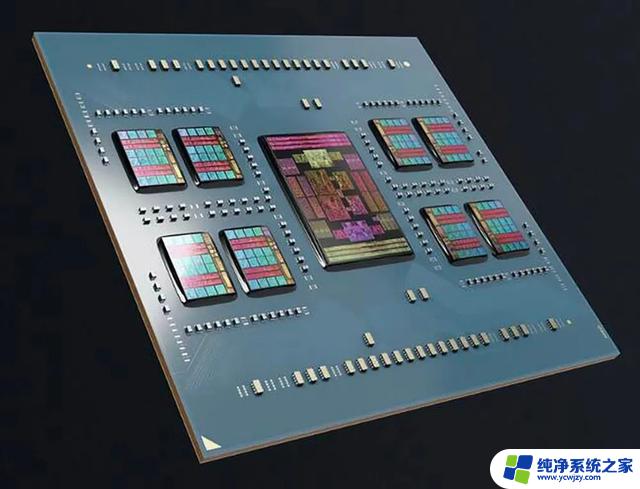

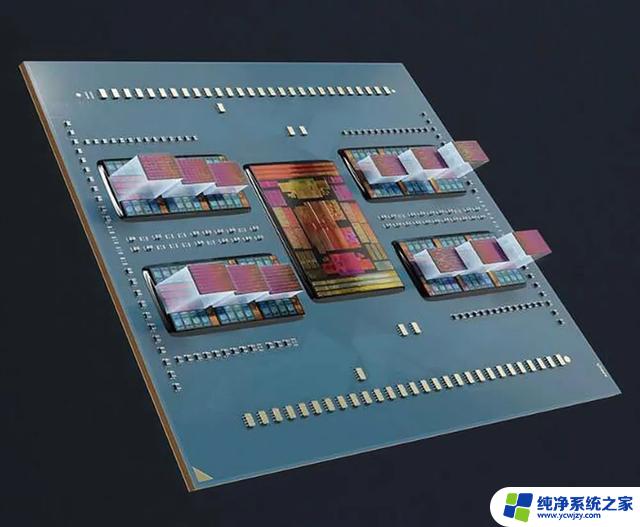

MI300X及其CDNA架构专为大型语言模型和其他先进AI模型而设计,将12个5nm chiplets封装在一起,共有1530亿颗晶体管。

这款全新AI芯片舍弃了APU的24个Zen内核和I/O芯片,转而采用更多的CDNA 3 GPU和更大的192GB HBM3,提供5.2 TB/s的内存带宽和896GB/s的无限带宽。

MI300X的HBM密度是英伟达H100的2.4倍,带宽是英伟达H100的1.6倍,这意味着AMD可以运行比英伟达芯片更大的模型。

AMD演示了在单个MI300X GPU上运行拥有400亿个参数的Falcon-40B大型语言模型,让它写了一首关于旧金山的诗。

“模型尺寸变得越来越大,你需要多个GPU来运行最新的大型语言模型,”苏姿丰说,随着AMD芯片上内存增加,开发者将不需要那么多GPU。

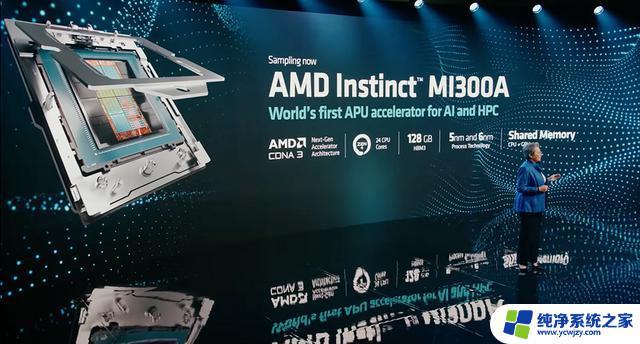

另一款MI300A被苏姿丰称作“面向AI和高性能计算的全球首款APU加速器”,将多个CPU、GPU和高带宽内存封在一起,在13个chiplets上拥有1460亿颗晶体管。

MI300A采用5nm和6nm制程、CDNA 3 GPU架构,搭配24个Zen 4核心、128GB HBM3,相比MI250提供了8倍以上的性能和5倍以上的效率。

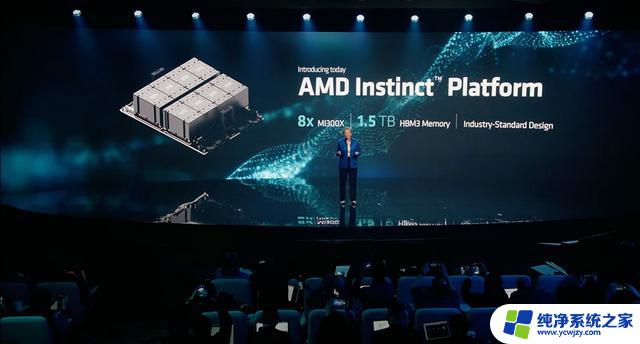

AMD还公布了一种AMD Infinity架构。该架构将8个 MI300X加速器连接在一个考虑了AI推理和训练的标准系统中,提供共1.5TB HBM3内存。

据台媒报道,AMD的Instinct MI300系列以及英伟达的H100/H800系列GPU都在采用台积电先进的后端3D封装方法CoWoS,导致台积电CoWoS产能短缺将持续存在。台积电目前有能力每月处理大约8000片CoWoS晶圆,其中英伟达和AMD合计占了大约70%到80%。

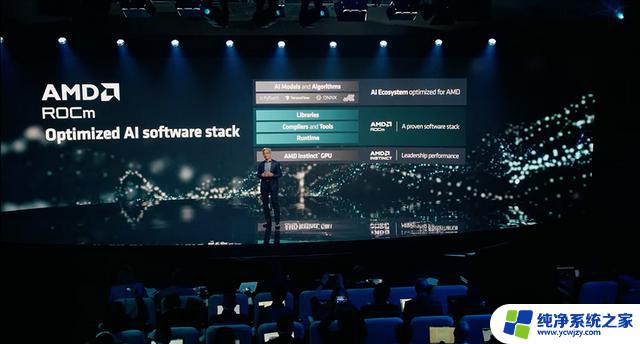

此外,英伟达近年备受开发者偏爱的一大关键护城河是CUDA软件。AMD 总裁Victor Peng也展示了AMD在开发软件生态方面所做的努力。

AMD计划在AI软件生态系统开发中采用“开放(Open)、成熟(Proven)、就绪(Ready)”的理念。

AMD的ROCm是一套完整的库和工具,用于优化AI软件栈。不同于CUDA,这是一个开放的平台。

AMD还分享了PyTorch与ROCm的合作。新的PyTorch 2.0的速度几乎是之前版本的两倍。AMD是PyTorch基金会的创始成员之一。

AMD正在不断优化ROCm。Victor Peng说:“虽然这是一段旅程,但我们在构建可与模型、库、框架和工具的开放生态系统协同工作的强大软件栈方面取得了真正的巨大进步。”

02.

云原生处理器Bergamo:

128核,256个线程,最高vCPU密度

再来看下AMD的数据中心CPU。

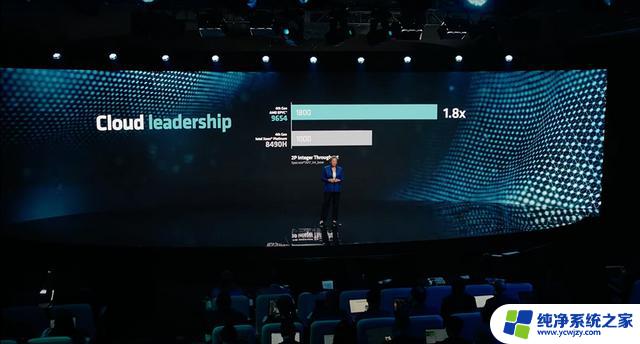

苏姿丰首先分享了AMD EPYC处理器的进展,特别是在全球范围内可用的云计算实例方面。

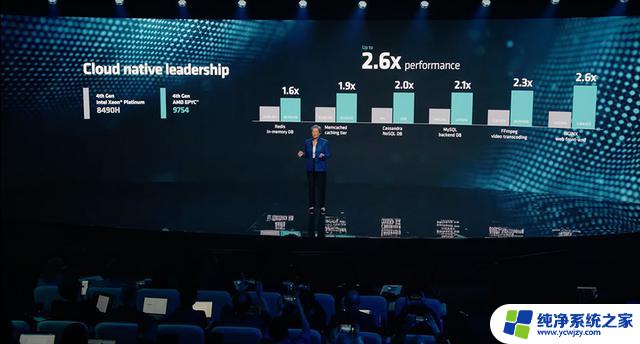

她强调说,AMD第四代EPYC Genoa处理器在云计算工作负载方面的性能是英特尔竞品的1.8倍,在企业工作负载方面的性能提高到1.9倍。

绝大多数AI都在CPU上运行,AMD称,与英特尔至强8490H相比,第四代EPYC在性能上遥遥领先,性能优势高出1.9倍。

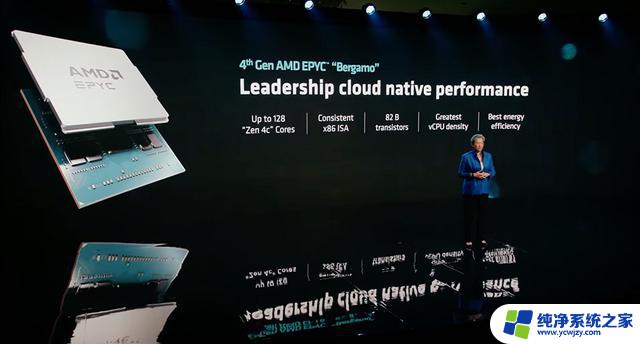

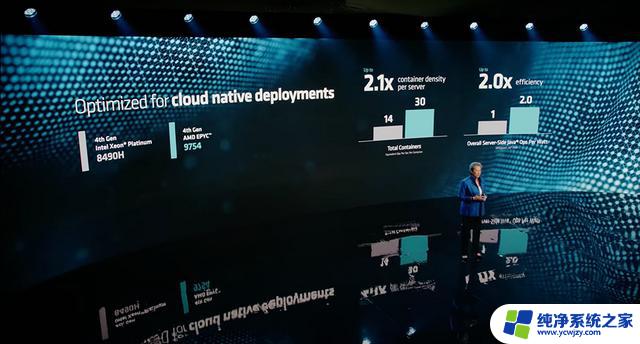

苏姿丰说,云原生处理器以吞吐量为导向,需要最高的性能、可扩展性、计算密度和能效。

新发布的Bergamo,便是云原生处理器市场的入口。

该芯片有820亿颗晶体管,提供了最高的vCPU密度。

在大散热器下,有一个表面看起来非常像以前的EPYC的芯片,跟与Rome或Milan一样有中央I/O芯片和8个核心复合芯片(CCD)。

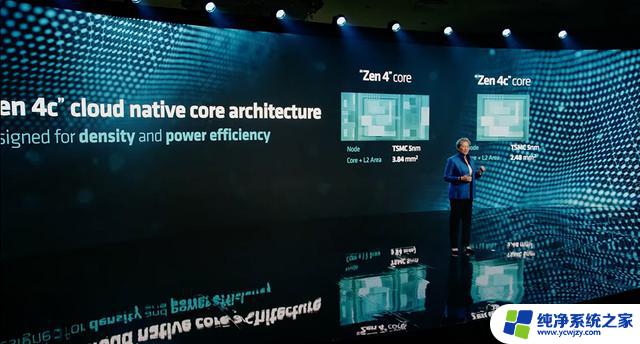

Bergamo的每个插槽有多达128个核心、256个线程,分布在8个CCD上。每个CCD的核心数量是Genoa 16个核心的两倍,采用比标准Zen 4内核提供更高密度的全新Zen 4c核心设计,并支持一致的x86 ISA。

“Zen 4c针对性能和功耗的最佳平衡点进行了优化,这为我们提供了更好的密度和能效,”苏姿丰在演讲中谈道,“结果设计面积缩小了35%,每瓦性能显著提高。”

Bergamo现在正在向AMD的云客户发货。AMD还分享了第四代EPYC 9754与英特尔至强8490H的性能、密度和能效和对比:

除了Bergamo的新核心和Chiplet架构之外,该处理器与Genoa有很多共同之处。包括支持12通道DDR5内存、最新PCIe 5.0、单插槽或双插槽配置等等。

不过,多核心不再只是AMD处理器独有的特色。不久之前,数据中心处理器新起之秀Ampere Computing刚推出拥有多达192个单线程Ampere核心的Ampere One系列处理器。英特尔也计划在2024年初推出内核优化的至强处理器Sierra Forest,将内置144个高效能核心。

AMD还展示了其最新的缓存堆叠X芯片,代号为Genoa-X,现已上市。

该芯片针对高性能计算工作负载,包括计算流体动力学、电子设计自动化、有限元分析、地震层析成像及其他带宽敏感型工作负载,这些工作负载受益于大量共享缓存。

Genoa-X CPU基于AMD的标准Genoa平台,采用AMD 3D V-Cache技术,通过在每个CCD上垂直堆叠SRAM模块来提高可用的L3缓存。

该芯片可提供多达96个内核和总计1.1GB的L3高速缓存,每个CCD上堆叠了一个64MB SRAM块。

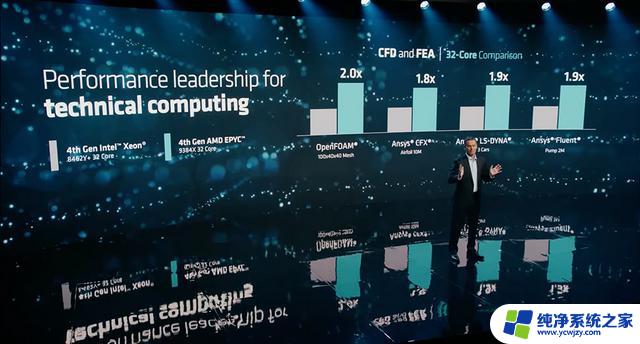

据AMD披露的数据,在各种计算流体动力学和有限元分析工作负载方面,与英特尔最高规格的60核Sapphire Rapids至强相比,Genoa-X缓存提升的性能提高到2.2倍到2.9倍。

下图是Genoa-X与相同数量核心的英特尔至强的性能对比:

03.

即将推出全新DPU

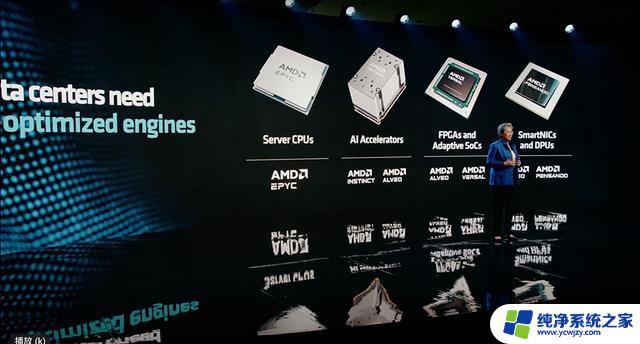

最后,AMD简要介绍了其网络基础设施。

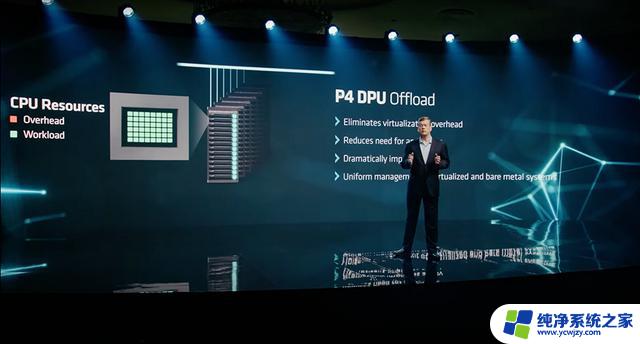

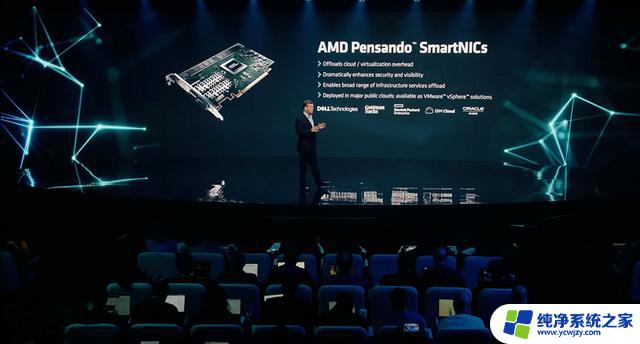

去年AMD以19亿美元收购Pensando,进入DPU赛道。AMD解释了如何使用其DPU来减少数据中心的网络开销。

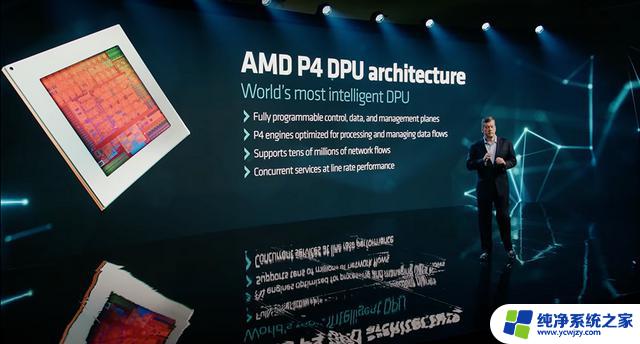

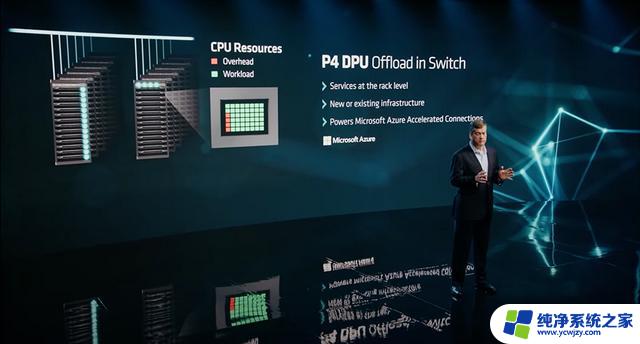

AMD将其P4 DPU架构称作“世界上最智能的DPU”,并称其Pensando SmartNIC是新数据中心架构不可或缺的一部分。

AMD还在现场展示了与Aruba Networks共同开发的智能交换机。AMD计划将P4 DPU卸载集成到网络交换机本身,从而提供机架级服务。

AMD最新的DPU旨在从CPU卸载网络、安全和虚拟化任务,与当前一代P4 DPU相比将提供更高的性能和能效。

其DPU已得到微软、IBM云、甲骨文云等许多主要云提供商以及VMware虚拟机管理程序等软件套件的支持。

AMD打算在今年晚些时候推出Giglio DPU之前扩大兼容软件列表,推出“芯片软件开发工具包”,以便用户更轻松地在其DPU上部署工作负载。

04.

结语:到2027年,数据中心AI加速器

市场规模将超过1500亿美元

全球数据中心GPU和CPU的头部企业英伟达和英特尔均在强调其加速AI的实力。作为这两条赛道“万年老二”的AMD,也在竞相满足对AI计算日益增长的需求,并通过推出适应最新需求的数据中心GPU来挑战英伟达在新兴市场的主导地位。

生成式AI和大型语言模型的应用热潮正在将数据中心推向极限。截至目前,英伟达在提供处理这些工作负载所需的技术方面具有优势。根据市场调研机构New Street Research的数据,英伟达占据了可用于机器学习的GPU市场的95%。

“我们仍处于AI生命周期的非常、非常早的阶段,”苏姿丰预测。到2027年,数据中心AI加速器总潜在市场规模将增长5倍,从今年的300亿美元左右以超过50%的复合年增长率增长到2027年的1500亿美元以上。

AMD并未透露两款MI300新芯片的价格,但这可能会给英伟达带来一定价格压力,之前H100价格据传高达30000美元乃至更多。